是的! 我們徵求工作夥伴! (深度學習算法開發單位, 新竹縣竹北市, 地址: 🗺️)

公司是意騰科技 intelliGo 成立於2016年, 一家專精於語音AI領域的公司, 並於 2025 年台股上市 (代號: 7749). 已有許多 AI 語音的解決方案, 一個代表例子為應用於 🎮 Switch2 GameChat 的方案 [新聞].

我們 (算法開發) 團隊正在招聘深度學習開發人員, 如果您願意與我們一起開發次世代語音技術, 打造影響全球使用者的功能, 別猶豫了! 請寄送您的簡歷與我聯繫: ✉️ bobondemon[at]gmail[dot]com

您將加入的團隊經歷過許多從 0 到 1 的新功能開發 (有些是業界首創), 同時也具有 1 到 100 的 scale up 產品經驗. 團隊文化注重每個人的成長, 並鼓勵鑽研與思辨, 而非僅求速成, 你能與一群同樣對技術有執著追求的夥伴共同成長!

我們正在尋找這樣的你/妳 (非語音領域的夥伴也沒問題喔 🙂)

$\circ$ 心態上: 樂於接受新題目的挑戰, 自我驅動力強 (對新技術或進步上有”饑渴感”), 熱衷於鑽研技術和深度思考 (注重理解透徹)

$\circ$ 本職學能上: 熟悉深度學習, 並有良好的數學能力, .e.g. 線性代數、機率、微積分、最佳化方法等, 能獨立閱讀論文了解某一問題的 SoTA 作法, 並快速實驗驗證想法, 同時持續迭代開發

$\circ$ 專案上: 能從客戶角度思考什麼才是成功的應用 (有時候複雜厲害的作法不一定打到客戶痛點)

加入我們能完整經歷從 AI 模型的誕生到部署, 再到客戶回饋打磨的完整 loop 過程.

詳細 Job Descriptions 如下 (別害怕別猶豫, 就是你/妳了!)

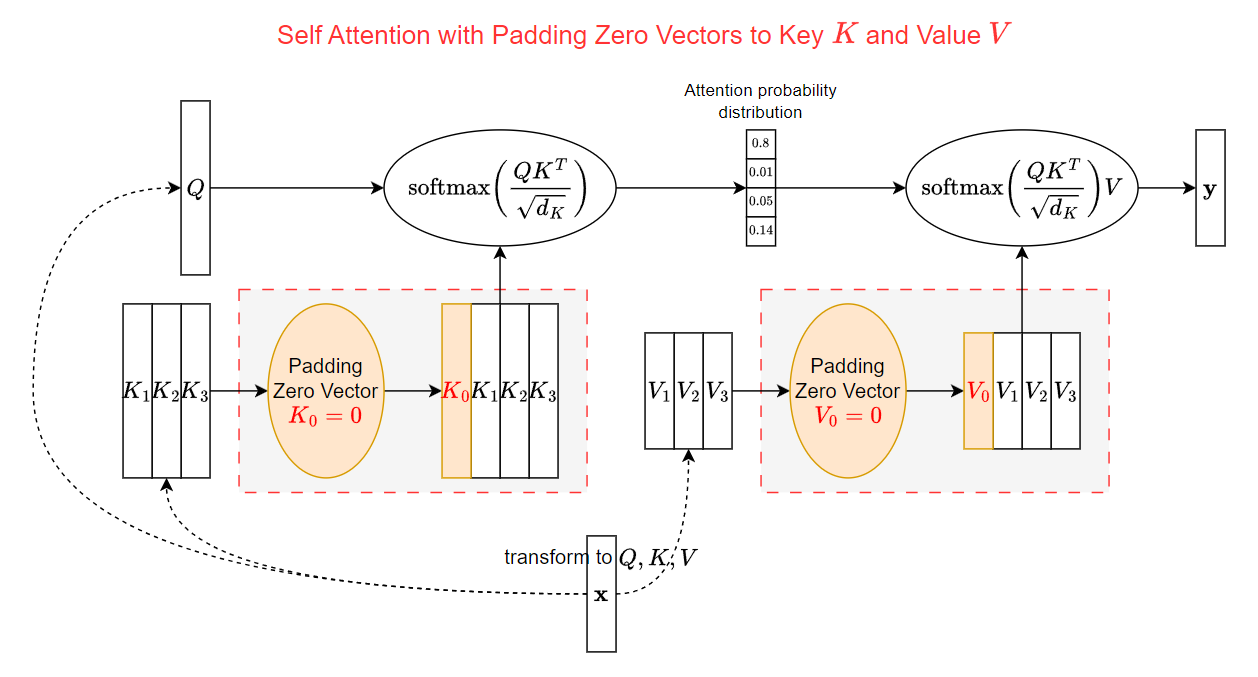

初次看到可能會很疑惑, 為啥要多 padding zero vectors? 本文就來解釋一下原因.

初次看到可能會很疑惑, 為啥要多 padding zero vectors? 本文就來解釋一下原因.